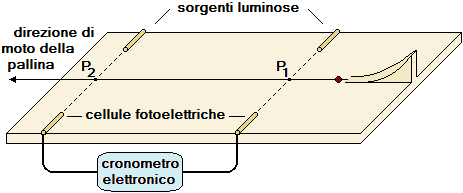

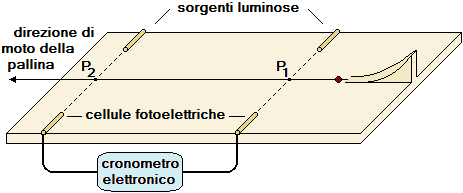

| Con un esperimento ripetuto più volte misuro il tempo di una pallina per andare lungo un piano orizzontale da un punto P1 a un punto P2 partendo sempre con la stessa velocità, ad esempio ottenuta abbandonando la pallina da uno scivolo che si raccordi col piano orizzonatale. I tempi con cui la pallina passa per i due punti sono rilevati con un dispositivo a fotocellula e misurati con un cronometro elettronico a bassa sensibilità che visualizza fino ai centimillesimi di secondo. Ottengo le seguenti 10 misure, in secondi: 4.31527, 4.32376, 4.31849, 4.32056, 4.31974, 4.31782, 4.31931, 4.32143, 4.32077, 4.32065. Come mai, con uno strumento così preciso, ottengo valori così fluttuanti? Cosa posso assumere come misura del tempo impiegato? |  |

Con uno strumento a bassa sensibilità ( le misure fisiche)

ci aspetteremmo di ottenere sempre la stessa misura. La fluttuazione dei valori ottenuti deve essere dovuta al fatto che la pallina non impiega

sempre lo stesso tempo per andare da P1 a P2. Le cause di ciò possono essere varie:

le misure fisiche)

ci aspetteremmo di ottenere sempre la stessa misura. La fluttuazione dei valori ottenuti deve essere dovuta al fatto che la pallina non impiega

sempre lo stesso tempo per andare da P1 a P2. Le cause di ciò possono essere varie:

• piccole asperità sul piano possono deviare il percorso della pallina dalla sua traiettoria ideale, dando luogo a variazioni della

lunghezza della strada percorsa e a conseguenti variazioni del tempo impiegato;

• il piano non può essere privo di attrito e a piccole variazioni del percorso possono corrispondere diversi effetti frenanti;

• i fasci di luce che dalle sorgenti vanno alle fotocellule non sono delle linee ideali, ma hanno dimensioni finite, e la corrente nella

cella fotoelettrica va a 0 non istantaneamente;

• per quanto la pallina venga lasciata cadere sempre nello stesso modo, essa in effetti arriverà in P1 con piccolissime

differenze di velocità;

• ecc.

In definitiva le cause di errore elencate non hanno niente a che fare con il cronometro:

• la precisione di una misura dipende dal modo in cui essa viene effettuata, non solo dalla bontà dei singoli strumenti impiegati;

• essa dipende quindi anche dallo sperimentatore (ad esempio dal modo in cui abbandona la pallina dallo scivolo).

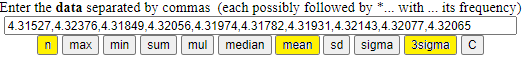

Posso fare tutti i calcoli col seguente script online (copiando e incollando i dati): vedi:

n=10 mean = 4.31978 3*sigma = 0.00216740859084391

Quindi: 4.320 ± 0.002

o col software online WolframAlpha (vedi), in cui al posto di "sigma"

si usa "standard error of the mean"

mean (4.31527, 4.32376, 4.31849, 4.32056, 4.31974, 4.31782, 4.31931, 4.32143, 4.32077, 4.32065)

4.31978

standard error of the mean (4.31527, 4.32376, 4.31849, 4.32056, 4.31974, 4.31782, 4.31931, 4.32143, 4.32077, 4.32065)

0.00072247

0.00072247*3

0.00216741

Naturalmente stiamo supponendo che non vi siano errori sistematici. Un errore sistematico è una quantità (positiva o negativa) che si aggiunge ogni volta che si ripete la misura con la stessa strumentazione. L'unico modo per rilevarne la presenza è ripetere la misura con altri strumenti che misurino la stessa grandezza di tipo e di fabbricazione diversa.

L'esempio è tratto dal manuale "Metodologia statistica della misura" di Goggi, Lodi Rizzini, Manuzio.

Per altri commenti:  I limiti in probabilità neGli Oggetti Matematici.

I limiti in probabilità neGli Oggetti Matematici.

# Posso fare i calcoli anche con R (vedi):

source("http://macosa.dima.unige.it/r.R")

x = c(4.31527,4.32376,4.31849,4.32056,4.31974,4.31782,4.31931,4.32143,4.32077,4.32065)

m = mean(x); m

# 4.31978

## la deviazione standard

sd(x)

# 0.002284649

## č il valore che otterrei con

sqrt(mean((x-mean(x))^2))*sqrt(10/9)

# 0.002284649

## deviazione standard della media

sd(x)/sqrt(10)

# 0.0007224695

## precisione al 99.7%

e = sd(x)/sqrt(10)*3; e

# 0.002167409

m; e; m-e; m+e

# 4.31978 ± 0.002167409 4.317613 4.321947

## Prendo 4.3198 ± 0.0022 Verifica:

4.3198 - 0.0022; 4.33198 + 0.0022

# 4.3176 4.3220

## OK, 4.317613, 4.321947 stanno in [4.3176, 4.3220]

## Piů in breve:

mean(x); SdM(x)

# 4.31978 0.0007224695

3*SdM(x); mean(x)-3*SdM(x); mean(x)+3*SdM(x)

# 0.002167409 4.317613 4.321947

# Prendo 4.3198 +/- 0.0022 o piů grossolanamente 4.320 +/- 0.002